Una coscienza per l’intelligenza artificiale

Oel ngati kameie è il saluto nella lingua dei Na’vi, gli umanoidi di Pandora. Significa “Io vedo dentro di te”.

Il saluto, che è fare immagine della sensorialità, a tredici anni di distanza dal film di James Cameron potrebbe entrare dentro l’attuale dibattito scientifico e filosofico sull’Intelligenza Artificiale. Che dal lontano 2009 ha sviluppato ben più sofisticate interfacce fino ad arrivare a modelli di IA altamente complessi e funzionali, che pongono la più temuta e avventurosa delle domande: è possibile una coscienza nelle creature di Intelligenza Artificiale?

Nel 2020 il Generative Pre-training Transformer 3 (Gpt-3), creato dall’ OpenIA fondata da Sam Altman e da Elon Musk, ha superato - per così dire - la primitività della cultura orale degli Avatar Na’vi. Con il suo algoritmo di 175 miliardi di parametri, Gpt-3 è in grado di scrivere come un essere umano. La sua capacità di elaborazione, correlata agli input, è assemblativa e non razionale; tuttavia, Gpt-3 è capace di memorizzare ed emulare l’attività più squisitamente umana: la scrittura. Il Guardian ha persino pubblicato un saggio scritto dall’algoritmo proprio sul rapporto tra IA ed esseri umani.

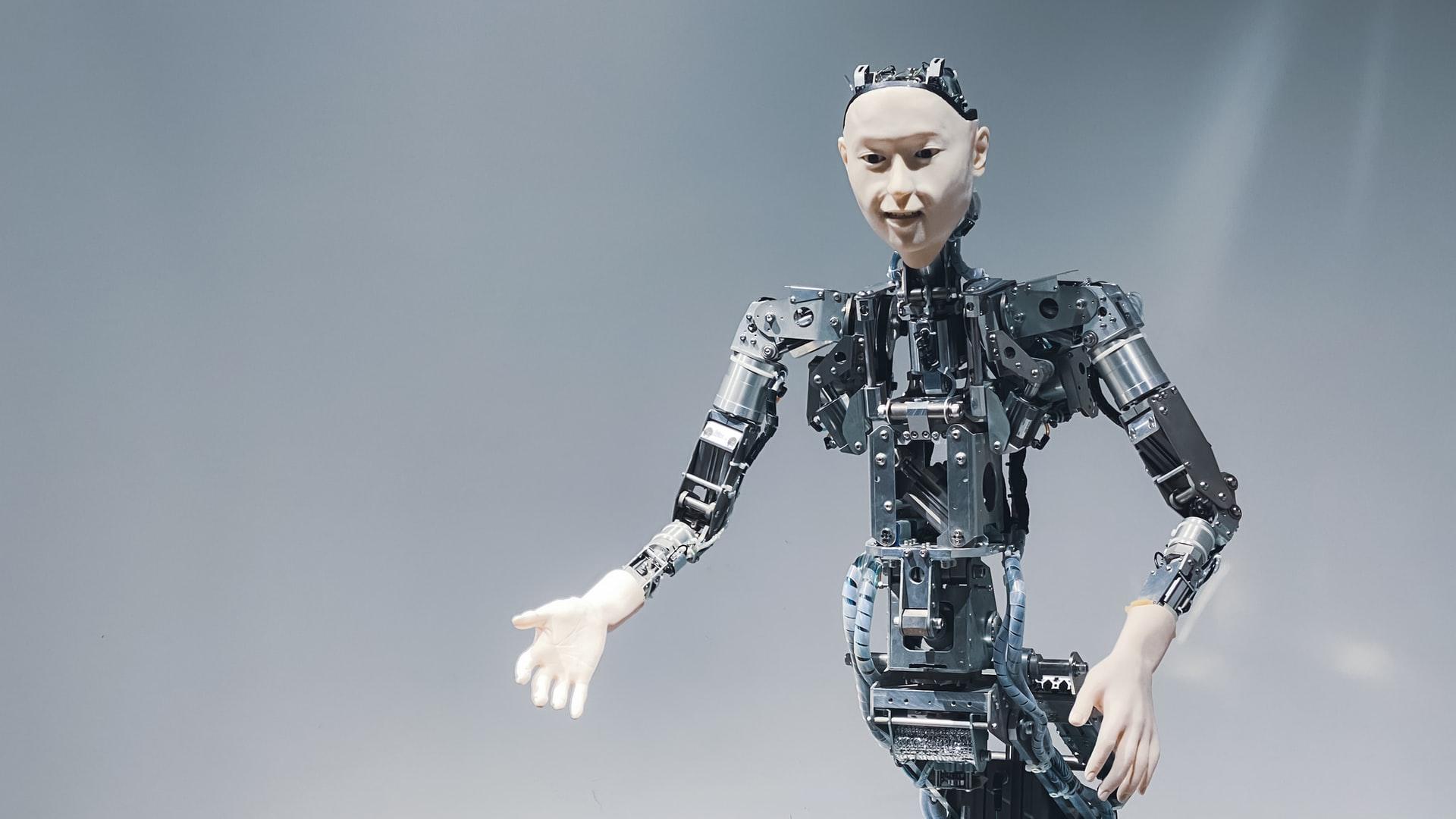

Alla Biennale del 2021 l’Istituto Italiano di Tecnologia ha presentato la versione più avanzata di iCub 3. Il robot, ancora un solo esemplare peraltro costosissimo, è in grado di interagire con l’ambiente circostante: passeggia, vede, afferra oggetti, stringe mani. Straordinario è l’esperimento, di qualche giorno fa, con iCub 3 nel Padiglione Italiano della Biennale di Venezia. Il robot è diventata una guida turistica in una Venezia, che mai avrebbe immaginato la sua incurabile bellezza sospesa tra realtà e virtuale, o addirittura diventare l’ambiente di un nuovo metaverso. Da una parte qualsiasi del mondo (nell’esperimento, a Genova) un essere umano indossa visore, guanti sensori e la tuta Ifeel (creata dall’IIT per far interagire iCub 3 con l’uomo) e cammina su un tapis roulant; dall’altra iCub 3 che visita il Padiglione al posto dell’uomo: un turista e il suo avatar. L’uomo dice “You can use my eyes”: se nella prospettiva letteraria è di meno di “Io vedo dentro di te”, in quella scientifica prefigura la possibile trasformazione dell’IA dalla globalizzazione alla globalità.

Più del gigantesco e incosciente algoritmo Gpt-3, il simpatico robot turista mostra una coscienza, ovvero una consapevolezza del mondo esterno. Sebbene sia chiaramente una consapevolezza dipendente dall’uomo che lo manovra. Ma, in effetti, chi è il manovratore: l’essere umano che viaggia intabarrato nella tuta Ifeel o il piccolo adolescente robotico che lo fa viaggiare? La risposta potrebbe essere meno ovvia di quanto appare. E molto filosofica.

In “Sentire e conoscere” (Adephi Editore) il neuroscienziato Antonio Damasio, indagando l’intelligenza senziente degli organismi viventi e non viventi, fa una doverosa incursione nel mondo delle macchine e afferma: “È evidente che possiamo sviluppare macchine operanti lungo le linee dei «sentimenti omeostatici». Quello di cui abbiamo bisogno, per farlo, è di fornire ai robot un «corpo» che, per conservarsi, richieda regolazioni e aggiustamenti. In altre parole, quasi paradossalmente, dobbiamo aggiungere alla robustezza tanto apprezzata nella robotica un certo grado di vulnerabilità.” Sembra descrivere iCub 3 e frena sulla coscienza: “Il «grado» di coscienza raggiunto infine da tali macchine dipenderà dalla complessità delle sue rappresentazioni interne”. Ossia, un robot non può avere una coscienza perché non sa crearsi immagini del reale e di sé. Quello che Byung-chul Han afferma quando distingue tra dimensione analogica del pensiero e dimensione digitale dell’Intelligenza Artificiale. Macchine senzienti ma non coscienti.

Credits: Taiki Ishikawa su Unsplash

Luciano Floridi nel suo ultimo saggio “Etica del pensiero artificiale” (Cortina Editore), partendo dalla descrizione della compattezza dell’analogico contro la discrezionalità plankiana del digitale, afferma che bit e pixel permettono la formazione di due universi paralleli: il mondo reale il cui territorio è lo spazio fisico e il mondo virtuale in cui la digitalizzazione ha determinato un vasto territorio reticolare. Dentro di esso l’uomo agisce, interagisce, capisce mentre l’IA agisce sotto forma di riproduzione di dati ma non conosce. iCub 3 sarebbe, in questa ottica, un’intelligenza non riflessiva né pioneristica: non potrebbe innamorarsi a Venezia e forse nemmeno morire. iCub 3 potrebbe essere ed è, per parafrasare Floridi, un ingegnere.

Nella determinazione di una possibile coscienza, o anche di un’etica robotica, occorre considerare quanta autonomia concediamo alle creature di IA. E’ remoto il tempo in cui un robot si affranchi completamente dall’uomo – gli manca la specialità dell’intelligenza biologica - ma è vicinissimo il tempo- possiamo chiamarlo già presente - in cui l’uomo si lasci dominare per pigrizia (vedi la domotica o l’acquiescenza alla disponibilità dei data), per necessità (lo smart working che si serve di device e cloud), per divertimento (il metaverso) dall’IA, rinunciando alla coscienza piena del mondo in cui vive. Inadatto al futuro come pensavano Julian Savulescu e Ingmar Persson, quando auspicavano una nuova consapevolezza che colmi il gap storico - temporale tra morale e tecnologia.

Certo la rassicurante legge dell’androide Adam di Ian McEwan “Un robot non può recar danno a un essere umano né può permettere che, a causa del proprio mancato intervento, un essere umano riceva danno" potrebbe aiutare a immaginare un mondo in cui l’IA generi umanoidi vocati al bene e perfettamente in grado di dominare in modo positivo il mondo esterno.

Resta il dubbio se questa forma - seppur nella finzione letteraria - di transumanesimo ottimista valga anche in un metaverso (finto ma meno letterario) in cui un robot, meno empatico di iCub 3, sia indotto all’aggressività, decretando così l’innocenza del suo algoritmo e di chi lo scrisse.

Credits Copertina: Adrien Converse su Unsplash

Leggi anche

100 anni di Istituto Luce, la storia d’Italia raccontata per immagini

Podcast, proiezioni e mostre per celebrare il secolo di vita dell’archivio cinematografico e fotografico

Don Chisciotte e Calibano

Le macchine inseguono l'umanità nel tempo, suscitando timori di sostituzione.

Futuro digitale

Da almeno un ventennio, il discorso pubblico sul futuro della nostra economia oscilla tra due estremi.

Homo Digitalis. Una sfida all’invisibile e il Big Bang del Metaverso

Intervista a Simone Arcagni, professore all’Università di Palermo.