Ambivalenza o equivalenza

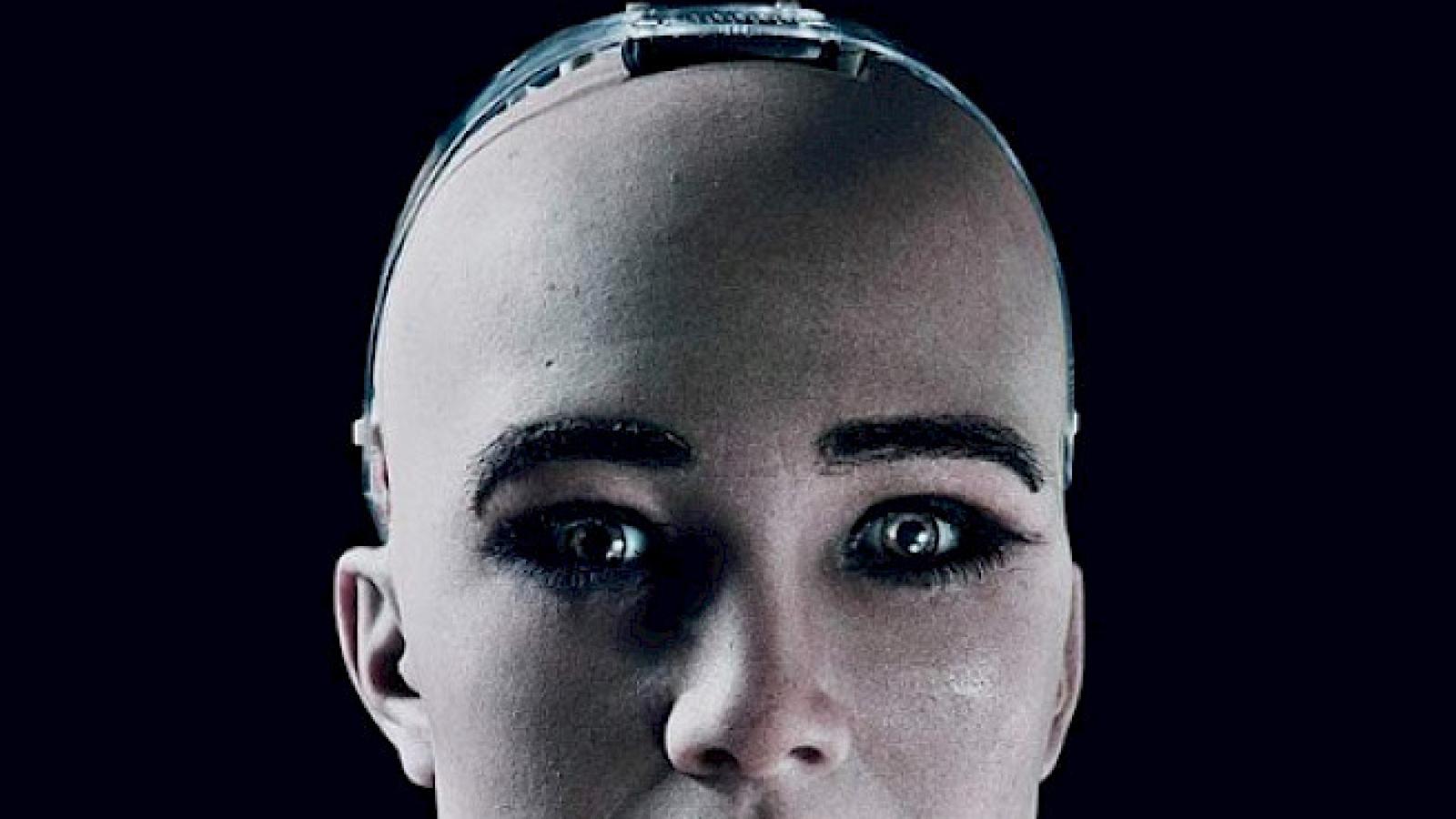

Se in una chat attribuite umanità al vostro interlocutore, e questi si rivela una macchina, allora si tratta di una macchina intelligente. Un’intelligenza artificiale.

Da questa idea, apparsa in un articolo negli anni Cinquanta del Novecento, proiettiamoci alla contemporaneità e il quadro cambia. Pervasiva, onnipresente, l’intelligenza artificiale lascia presagire futuri sociali distopici e sollecita angosce. Mettiamoci di fronte a questo dato e chiediamoci: perché tanta paura dell’intelligenza artificiale? Non parlerò di lavoro o di società, ma di noi, noi esseri umani.

L’incipit di questo articolo sintetizza il celebre test ideato da Alan Turing, il logico e matematico inglese che, come disse Winston Churchill, «diede il contributo individuale più importante per la vittoria sul nazismo». Turing, con quel test, offriva una soluzione operativa – imponeva delle azioni – a una domanda altrimenti elusiva: le macchine possono pensare? Invece di intrappolarci in definizioni, Turing proponeva una procedura: parlateci e, se vi sembrano intelligenti, saranno intelligenti. Il fatto è che non ci sono le tavole della Legge che decidono chi pensa e chi no, chi è intelligente e chi no. Come i giudizi sull’uso appropriato del linguaggio le fanno i parlanti, così le valutazioni sull’intelligenza degli individui le fanno i pensanti. Le facciamo noi.

Il superamento del test che alcuni programmi esibiscono, sebbene su domini ristretti della conoscenza, sembra stabilire una equivalenza: su un certo argomento potete parlare con esseri naturali o artificiali e otterrete risposte sensate e appropriate. Ecco il primo seme della paura: l’equivalenza può dar adito all’ambivalenza? Se io e la macchina siamo equivalenti, in qualche modo indistinguibili, cosa offro io di più, o di diverso, dalla macchina? Questo porta all’ambivalenza: ha parlato un umano o il suo simulacro artificiale? L’equivalenza, una nozione logica che consente di scambiare due elementi senza variare ulteriori rapporti, genera, con l’ambivalenza, un’ambiguità perché apre le porte a una categoria diversa, all’artificiale dove lì esisteva il naturale. Il seme è ben piantato in profondità. Desmond Morris si è confrontato con la natura della nostra specie ne “L’animale uomo”, insistendo sulla componente naturale e istintuale che alberga in noi, che sicuramente siamo una specie intelligente ma pur sempre una specie naturale. Il concetto di naturalità, tuttavia, affonda le proprie radici nella meccanicità, nel pensare alla natura come al dominio delle relazioni fisico-meccaniche e a concepire gli animali come automi, secondo le tesi di Cartesio. Julien Offray de La Mettrie, nel Settecento, esaspera l’ipotesi cartesiana passando dal sostenere l’automaticità di tutte le specie naturali, inclusa la nostra, e ci apostrofa come uomini-macchina. Non già l’animale che è in me ma l’automa che è in me. E se è in me e siamo equivalenti e ambivalenti, io umano per cosa mi distinguo?

Ada Lovelace, matematica, gentildonna e moglie del poeta Byron, aveva dato una chiara indicazione per bloccare il rovello: la macchina fa quello che noi le diciamo di fare. Sarebbe dunque l’autonomia il chiavistello per la distinzione: noi umani decidiamo autonomamente cosa fare, le macchine sono le nostre schiave. Delle compagne automatiche, suggeriva William James (maschilistica! Le chiamava automatic sweetheart). Ma poi valla a definire l’autonomia. Siamo autonomi perché le nostre decisioni non dipendono dagli altri? Poco credibile, intessuti come siamo nelle relazioni sociali. Perché abbiamo il libero arbitrio? Argomentazione circolare perché l’arbitrio altro non sarebbe che l’autonomia. Perché siamo creativi? Insiste Chomsky: la creatività è frutto di regole. E dopo tutto, sappiamo quanto siamo condizionati nell’espressione delle nostre preferenze dalla profilazione che fanno algoritmi sofisticati all’opera su masse di dati. Così, la nostra autonomia risulta un piccolo spazio di manovra nelle code di probabilità delle previsioni algoritmiche. Insomma, l’autonomia non è un terreno così solido per marcare la distinzione e poterci togliere dal contrasto equivalenza/ ambivalenza.

C’è un secondo fronte da considerare nella ricerca dell’origine della nostra paura. L’obiezione di Lady Lovelace non indica soltanto l’ipotetica mancanza di autonomia delle macchine, indica il nostro potenziale dispotismo nel loro uso: la macchina fa ciò che le dico di fare, risponde a me, che solo la comando. Io, despota, ordino alla macchina di fare quel che voglio, al robot di fare cosa mi aggrada, al sistema d’arma autonomo di andare e colpire il nemico come da istruzioni. E la macchina va, autonoma entro certi limiti, a identificare, inquadrare e colpire come da ordini. E il dispotismo si associa all’egoismo: la macchina che assiste si deve occupare solo di me. Alexa risponde solo a me. In Giappone, nelle case di riposo, gli anziani preferiscono essere accuditi più dai robot che dagli inservienti umani: sono più affidabili, dediti, mai scontrosi. Abbiamo quindi due paure: la prima è che noi e i nostri simulacri artificiali potremmo essere confusi e scambiati l’uno per l’altro; la seconda è che nell’interazione con l’artificiale potremmo rivelare il nostro spirito peggiore, quello di despoti egoisti che chiedono alle macchine di dar corso solo ai propri desideri o di mettere in atto i propri fini, incuranti del fatto che le conseguenze artificiali impattano sul mondo naturale. Del bambino che avrebbe preferito il robot accondiscendente al genitore intollerante.

La prima paura rivela la seconda, nella quale finiamo con l’essere, per dirla con il filosofo Gilbert Ryle, «il fantasma dentro la macchina». E queste due paure, variando una poesia di Edgar Allan Poe, si nascondono a vicenda, come fossero «una paura dentro una paura».

Leggi anche

"La valle oscura": vivere e morire nella Silicon Valley

Da tempo ormai la Silicon Valley è al centro delle attenzioni, spesso ossessive, di opinione pubblica, intellettuali, politici e semplici curiosi.

150 anni di Marconi: il primo imprenditore globale dell’innovazione

Elettra Marconi racconta il padre e la nave laboratorio che porta il suo nome: a bordo dello yacht Elettra l’inventore della radio ha girato il mondo compiendo straordinari esperimenti

5G, la tecnologia plasma il futuro: l'umanità è un'appendice superflua

Gli spot sulla nuova rete internet sono il manifesto dell'ideologia tecnocratica: la fantascienza è già scienza.

Astronavi sulle spighe

Peppino Caldarola – già redattore presso il catalogo Laterza, due volte a capo de “l’Unità”, direttore di “Civiltà delle Macchine” – è stato un comunista.