Curve esponenziali

Con gli occhi del XXI secolo, probabilmente, il Novecento apparirà come una grande corsa verso un futuro tanto annunciato quanto ignoto.

Una trasformazione della vita degli umani, in qualità e quantità, culmine di un percorso straordinario avviato, lentamente, in Europa alla fine del Settecento e più velocemente nell’Ottocento. Fino appunto all’accelerazione senza precedenti del XX secolo, rappresentata da quelle curve di crescita esponenziale che descrivono l’andamento delle variabili fondamentali, demografiche, economiche, ambientali, e che sembrano piatte per secoli fino a quando esplodono in una salita quasi verticale. Cambiamenti radicali accompagnati da innovazioni tecnologiche in precedenza impensabili, dalla penicillina all’energia nucleare, dai voli spaziali ai computer personali, dal web alla lettura del genoma. Tutte tecnologie dalla genealogia intrecciata, inseparabili le une dalle altre, ma pure emblematiche, ciascuna, di un futuro fantascientifico divenuto realtà. E come in ogni nuovo secolo, il precedente resterà a testimoniare contemporaneamente i risultati raggiunti e i problemi irrisolti. O aumentati.

L’impressione di crescita impetuosa e inarrestabile della quale gli umani hanno potuto fare esperienza ruota intorno alla crescita della popolazione. Da un miliardo nel 1800 a un miliardo e mezzo nel 1890. E poi due miliardi intorno al 1920, tre miliardi verso il 1960, cinque miliardi circa nel 1990, otto miliardi nel 2023. Ma naturalmente gli umani si sono moltiplicati perché i mezzi di sostentamento sono aumentati ancora più velocemente: le persone sono quadruplicate, nell’ultimo secolo, il PIL globale è cresciuto di venti volte.

La curva esponenziale è diventata una sorta di monumento a questo fenomeno, caratteristico del XX secolo. Ma il XXI secolo dovrà cercarsi un nuovo andamento caratteristico. Perché l’esplosione degli umani incontrerà i suoi limiti. Il che non significa che l’innovazione tecnologica rallenterà. Significa che si dovrà mettere al servizio di obiettivi dotati di un senso. Lo aveva annunciato, nel 1972, il gruppo di ricerca che al MIT aveva stilato il rapporto per il Club di Roma chiamato “I limiti dello sviluppo” (cioè della “crescita” nella versione originale). In un contesto culturale che ancora ragionava per schemi lineari, gli autori di quello storico rapporto, Donella e Dennis Meadows, Jørgen Randers e William Behrens, affrontavano la complessità delle interrelazioni tra le variabili. Scoprendo che la crescita della produzione industriale si confrontava con la limitatezza delle risorse non rinnovabili, la popolazione si doveva mettere in relazione con la capacità della produzione agricola e ogni fenomeno si manifestava in un ambiente che si deteriorava. Sicché, facevano notare gli autori, la crescita di ciascuna variabile generava conseguenze sulle altre; inoltre ciascun fenomeno produceva feedback che piegavano la traiettoria di tutti gli altri. I risultati finali non erano certi: si potevano soltanto descrivere attraverso scenari alternativi.

Tutto questo introduceva enormi differenze rispetto ai modelli lineari ai quali erano abituati gli economisti dell’epoca della catena di montaggio e della fiducia nel mercato. In quei modelli, il numero di equazioni era pari a quello delle variabili e i risultati erano in qualche modo prevedibili. Nel modello del MIT, invece, le relazioni tra le variabili si inserivano in un contesto di complessità, nel quale ogni fenomeno co-evolveva con gli altri. Nel modello lineare, un aumento della produzione agricola faceva scendere i prezzi e migliorava la vita dei consumatori che potevano usare i loro soldi per altri prodotti: non ci si aspettava nulla di problematico, se il sistema era concorrenziale, soltanto una migliore allocazione delle risorse. Nel modello del MIT, invece, un aumento della produzione agricola, per esempio, consentiva di sfamare più persone e generava un aumento demografico che, a sua volta, avrebbe favorito una maggiore produzione industriale e quindi più inquinamento e consumo di risorse, provocando alla fine un ambiente invivibile e una possibile catastrofe agricola e demografica. Insomma, ogni crescita esponenziale si confrontava con i limiti del suo contesto e a un certo punto piegava nella classica curva a “esse”, la logistica, quella che dopo la crescita esponenziale conosce un rallentamento successivo. E in certi casi, addirittura, un declino.

Dalla pubblicazione de “I limiti dello sviluppo” l’attenzione per l’andamento esponenziale di certe variabili socioeconomiche è lentamente cresciuto. Senza mai essere particolarmente compreso. Alla metà degli anni Novanta, il giovane Jeff Bezos, che aveva lasciato un lavoro di tecnico a Wall Street per andare a fondare un negozio di libri online a Seattle chiamato Amazon, raccontava internet osservando: «Se una cosa cresce del 2300% all’anno vale la pena di prestare molta attenzione». Non tutti lo ascoltavano. Nello stesso periodo, Nicholas Negroponte, fondatore del MIT Media Lab e autore di “Essere digitali”, doveva ricorrere alla stessa storia che i Meadows e gli altri avevano usato nel 1972 per spiegare la dinamica esponenziale: il servo dell’imperatore prese in mano una scacchiera e chiese come ricompensa per i suoi servigi un po’ di riso, in una quantità apparentemente modesta e, in particolare, un chicco sulla prima casella, due sulla seconda, quattro sulla terza e così via. L’imperatore accettò perché non aveva idea della forza della matematica esponenziale. I chicchi di riso richiesti già verso metà scacchiera erano tanti che tutto il suo regno non bastava a produrli. E alla fine il servo mandò in bancarotta tutto l’impero.

La cultura digitale si fondava sulla dinamica esponenziale in modo fondamentale. Il motore di tutto era la legge di Moore che osservava come la capacità di elaborazione dei microprocessori raddoppiasse ogni 18/24 mesi a parità di costo. E si associava alla legge di Metcalfe che osservava come il valore di una tecnologia di rete crescesse geometricamente con il numero di nodi che l’adottavano. Negli anni Novanta e nel primo decennio del nuovo millennio queste osservazioni apparivano trionfanti. La curva esponenziale era inarrestabile. E la cultura digitale sembrava destinata a sfondare ogni senso del limite. Chi comprendeva la forza della crescita esponenziale poteva immaginare fenomeni impensabili per chi non la comprendeva, compresa la singolarità che serviva a presentare una storia fantascientifica in una prospettiva ineludibile: grazie alla legge di Moore i computer sarebbero a un certo punto diventati tanto potenti da superare in intelligenza l’intera umanità che, in quelle condizioni, non avrebbe avuto altra scelta che sublimarsi in una inedita specie tecnobiologica e dare vita a una nuova fase dell’evoluzione. Frotte di adepti cercavano l’illuminazione alla Singularity University, pagando 10.000 dollari alla settimana, per venire addestrati a credere a quella storia e a guardare dall’alto in basso chi non ne condivideva i presupposti e i risultati. Del resto, la finanza non cessava di investire in quell’idea, cercando le cosiddette tecnologie scalabili, cioè tali da poter godere di andamenti esponenziali. Il modello era indubbiamente attraente. E per chi lo sapeva cavalcare provocava ricchezze immense.

Quel modello sembrò scricchiolare con la crisi della finanza autoreferenziale del 2007 ma fu rafforzato invece dall’introduzione in quello stesso anno dello smartphone della Apple che avrebbe dato una nuova, enorme spinta a tutto il mondo di internet. Le applicazioni si moltiplicarono, il cloud computing diventò un’opzione credibile, la vita degli umani fu modificata da quello strumento che si trasformò velocemente in una sorta di protesi cerebrale irrinunciabile.

Una grande alternativa si apriva davanti agli occhi dell’umanità. L’approccio malthusiano secondo il quale prima o poi una crescita esponenziale deve raggiungere il suo limite appariva smentito dall’innovazione tecnologica che spostava incessantemente quel limite del possibile. Eppure il finale della storia era difficile da scrivere. Perché l’emergenza climatica non cessava di suggerire che alla fine l’ambiente retroagiva in modo molto pericoloso. Perché i rischi psicologici e culturali dei social network mostravano come le nuove tecnologie non hanno soltanto conseguenze positive. Perché i costi energetici dei grandi modelli a base di intelligenza artificiale apparivano pericolosamente fuori controllo. E così via.

Anche oggi come ai tempi de “I limiti dello sviluppo” il futuro si interpreta innanzitutto elaborando scenari credibili e alternative razionali. Ma poi si affronta prendendo di petto i problemi e trasformandoli in opportunità per l’innovazione. E d’altra parte si può benissimo immaginare che uno scenario di declino in un settore si possa verificare in presenza di andamenti diversi in altri settori. Alla fine non c’è un’ineludibile catastrofe o un inevitabile trionfo della tecnologia

C’è un aggiustamento del modo di concepire l’innovazione che, probabilmente, può cessare di derivare semplicemente dalla progettazione di sistemi tecnici e approfondirsi nella progettazione di sistemi sociotecnici. Che tengano cioè conto, fin dal concepimento e dallo sviluppo, delle dinamiche sociali che si creano introducendo nuove tecnologie nella società.

Leggi anche

"La valle oscura": vivere e morire nella Silicon Valley

Da tempo ormai la Silicon Valley è al centro delle attenzioni, spesso ossessive, di opinione pubblica, intellettuali, politici e semplici curiosi.

150 anni di Marconi: il primo imprenditore globale dell’innovazione

Elettra Marconi racconta il padre e la nave laboratorio che porta il suo nome: a bordo dello yacht Elettra l’inventore della radio ha girato il mondo compiendo straordinari esperimenti

5G, la tecnologia plasma il futuro: l'umanità è un'appendice superflua

Gli spot sulla nuova rete internet sono il manifesto dell'ideologia tecnocratica: la fantascienza è già scienza.

Ambivalenza o equivalenza

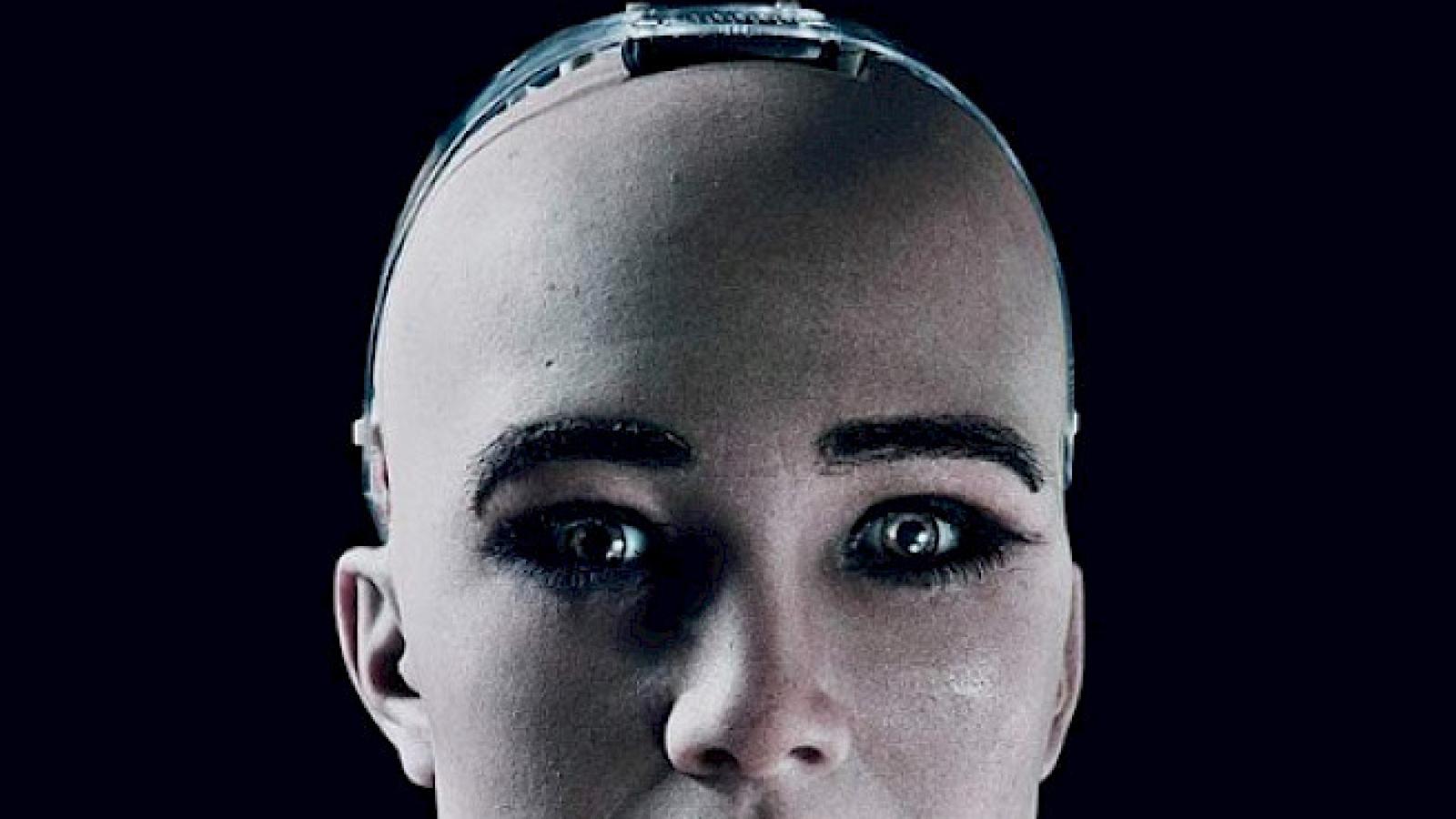

Se in una chat attribuite umanità al vostro interlocutore, e questi si rivela una macchina, allora si tratta di una macchina intelligente. Un’intelligenza artificiale.