I rischi di sempre

L'automazione non crea problemi nuovi, tranne per il riaddestramento.

Automazione e mercato del lavoro: che cosa c’è di nuovo

«Chiunque sia abbastanza anziano per ricordare gli anni precedenti la guerra, nel leggere l’ultimo capitolo deve essere stato indotto a commentare più volte: “in tutto ciò non vi è nulla di nuovo”. Nel complesso, credo che questo commento sia giustificato. L’automazione in generale non crea problemi nuovi. Vi sono un paio di eccezioni: il fatto che l’automazione rovescia la vecchia tendenza alla sostituzione di lavoratori non qualificati a quelli specializzati dà origine ad alcuni problemi nuovi per quanto riguarda il riaddestramento di persone in età matura». Questa citazione è tratta dal libro “Automazione e progresso sociale” di Sam Lilley, pubblicato nel 1957 a Londra e tradotto in italiano nello stesso anno dalla CGIL per Editori Riuniti. Se non fosse per il riferimento alla guerra, che determina la collocazione storica di questo estratto, si tratta di osservazioni che potrebbero essere riferite all’analisi della situazione attuale. La stessa espressione – “non vi è nulla di nuovo” – si ritrova, per esempio, in questa dichiarazione di Daron Acemoglu: «L’automazione, ossia la sostituzione di macchine e algoritmi per compiti precedentemente eseguiti dalle mani e dalle menti umane, non è nulla di nuovo. […] Tuttavia, in passato faceva parte di un ampio portfolio tecnologico e i suoi effetti potenzialmente negativi sul lavoro venivano bilanciati da altre tecnologie che aumentavano la produttività umana e le opportunità di impiego. Ma non oggi. Gli ultimi due decenni hanno visto rapidi progressi nelle tecnologie dell’automazione, ma senza altrettanti investimenti in quelle che integrano il fattore umano».

Le analisi di Lilley negli anni Cinquanta e di Acemoglu nel 2020 mettono in luce gli elementi di continuità nel rapporto tra innovazione tecnologica e mercato del lavoro ma, al tempo stesso, invitano a prestare attenzione agli elementi di specificità di ogni nuova ondata di innovazione tecnologica. Negli ultimi anni, la famiglia di tecnologie che ha riaperto questo dibattito è un tipo di intelligenza artificiale capace di generare nuovi contenuti, come testo, immagini, audio e video, definito “intelligenza artificiale generativa”. A partire dal 2017, e con un picco nel 2023, si è registrata una crescita imponente delle pubblicazioni scientifiche relative a queste tecnologie. Inoltre, si stima che, a seguito dell’investimento di 10 miliardi di dollari di Microsoft in OpenAI, solo nella prima metà del 2023 gli investimenti di venture capital in questo campo siano stati pari a 12 miliardi di dollari. Il rilascio di ChatGPT a fine novembre dello scorso anno ha portato questi temi anche nel dibattito pubblico: gli articoli sulla stampa a livello globale sono passati da 1600 nell’ultimo quadrimestre del 2022 a 14.000 nel secondo quadrimestre 2023.

Pur mantenendo l’attenzione alla lunga durata richiamata dagli scritti di Lilley e Acemoglu, è importante prendere in adeguata considerazione gli elementi di specificità dell’intelligenza artificiale generativa messi in evidenza dalla letteratura. In particolare, se ne possono richiamare tre: il fatto che l’IA generativa sia una tecnologia general-purpose e che quindi andrà a interessare ogni settore e occupazione; l’allargamento dello spettro di compiti che possono essere automatizzati, che include attività non-routinarie e creative; e la velocità di sviluppo di queste tecnologie.

La disoccupazione tecnologica: dati e proiezioni

La letteratura finora non mostra effetti negativi dell’IA sull’occupazione, ma le ricerche disponibili riguardano prevalentemente le tecnologie che precedono questa nuova generazione di intelligenza artificiale. L’OECD Employment Outlook del 2023, dedicato al tema “Artificial Intelligence and the Labour Market”, evidenzia come, almeno per il momento, il livello di adozione dell’intelligenza artificiale generativa sia ancora limitato a sperimentazioni in grandi aziende, con uno scarso impatto sull’occupazione. Tra questi early adopters, non si registrano licenziamenti, ma strategie di aggiustamento attraverso la mancata sostituzione del personale dimissionario o in pensione e la riduzione delle assunzioni. Inoltre, in queste aziende non sono stati osservati cambiamenti nei livelli retributivi. Il dato positivo riguarda la qualità del lavoro: tra i lavoratori che svolgono attività in cui è stata introdotta l’intelligenza artificiale generativa, il 64% dichiara una riduzione delle attività pericolose o noiose e un miglioramento della soddisfazione lavorativa.

Nonostante questo, le previsioni mettono in luce rischi di disoccupazione tecnologica a seguito della diffusione dell’intelligenza artificiale generativa anche nelle piccole e medie aziende e i lavoratori si dichiarano preoccupati. Secondo le stime OECD, le occupazioni ad alto rischio di automazione sono il 27% del totale e 3 lavoratori su 5 dichiarano di temere di perdere il proprio lavoro nei prossimi 10 anni.

Uno studio ILO dell’agosto 2023 presenta proiezioni meno preoccupanti: per la maggior parte delle professioni, i task altamente esposti ad automazione sono limitati all’1-4%, mentre quelli mediamente esposti non superano il 25%. Questi dati, però, presentano forti variazioni: nei paesi a basso reddito solo lo 0,4% dell’occupazione totale è potenzialmente esposto agli effetti dell’automazione, mentre nei paesi ad alto reddito la quota sale al 5,5%; inoltre, la percentuale di donne potenzialmente colpite dall’automazione si stima sarà più del doppio di quella degli uomini.

I nuovi rischi, oltre la disoccupazione tecnologica

Se il tema della disoccupazione tecnologica resta al centro delle preoccupazioni, i report pubblicati negli ultimi mesi sul rapporto tra intelligenza artificiale e occupazione permettono di delineare anche le possibili trasformazioni qualitative del mercato del lavoro. Il report ILO sopra citato prevede che l’impatto più importante della tecnologia di nuova generazione sarà quello di intensificare il lavoro – automatizzando alcuni compiti all’interno di un’occupazione invece di automatizzare completamente le occupazioni. L’OECD Employment Outlook 2023 conferma questa ipotesi rilevando fenomeni di intensificazione del lavoro nelle aziende che già adottano l’intelligenza artificiale.

Acemoglu e Simon Johnson, nel libro “Power and Progress. Our Thousand-Year Struggle over Technology and Prosperity” (2023, John Murray Press), prefigurano un possibile intervento della politica e delle parti sociali per evitare gli scenari orientati sia all’automazione che all’intensificazione del lavoro, per indirizzare le scelte che riguardano la tecnologia verso la creazione di nuovi task, che vadano a incrementare il ruolo e il potere dei lavoratori.

Carl Benedikt Frey e Micheal A. Osborne, dieci anni dopo l’articolo “The Future of Employment” del 2013 in cui stimavano che il 47% dei lavori negli Stati Uniti fosse esposto al rischio di sostituzione da parte della robotica avanzata e del machine learning, lo scorso settembre hanno pubblicato il paper “Generative AI and the Future of Work: A Reappraisal” in cui sostengono che l’IA generativa non possa essere considerata, almeno nella sua forma attuale, una tecnologia di automazione e che porterà a processi di isomorfismo e consenso, più che a innovazione. Inoltre, prevedono che le nuove tecnologie legate all’intelligenza artificiale generativa possano aumentare la competizione tra i lavoratori. Questo perché l’intelligenza artificiale permetterebbe anche ai lavoratori non qualificati di svolgere attività che, in passato, richiedevano il possesso di competenze specifiche. L’esempio è Uber, che consente di fare l’autista a chiunque sappia guidare un’auto, pur non conoscendo la toponomastica stradale. Ritengono quindi probabile che i grandi modelli linguistici (LLMs – Large Language Models) mettano in discussione il ruolo dei lavoratori medi, senza toccare i lavoratori eccellenti. Secondo le loro previsioni, l’impatto sarà più forte nei contesti già virtuali – perché se un lavoro può essere svolto da remoto, potenzialmente può anche essere automatizzato – e nelle attività transazionali, che non necessitano di rapporti fiduciari a lungo termine.

Tra i rischi legati all’intelligenza artificiale, una letteratura ormai ampia mette in luce le sfide etiche legate alla protezione dei dati personali e della privacy, alle forme di discriminazione legate ai bias riprodotti dagli algoritmi e alla necessità di accountability e trasparenza dei processi decisionali automatizzati. L’OECD ha creato un AI Incidents Monitor che, a partire da un’analisi di articoli pubblicati nella stampa, ha rilevato più di mille incidenti relativi a problemi causati dall’intelligenza artificiale nel primo semestre 2023.

Una nuova politica industriale

La percezione delle tecnologie di IA come infrastrutture del futuro ha favorito l’emergere di una nuova stagione di politiche industriali orientate al loro rafforzamento. Gli studi di political economy comparata stanno mettendo in luce il fatto che le tecnologie legate all’intelligenza artificiale non rappresentano solo prodotti commerciali ma asset strategici di una nazione, in quella che viene definita come una nuova corsa agli armamenti tra USA e Cina (AI arms race). La competizione degli Stati Uniti con aziende cinesi, che non incontrano limiti nella costruzione di monopoli e nel controllo dei dati che vengono raccolti attraverso le piattaforme digitali, porta le élite tecnocratiche americane a richiedere di limitare la regolazione antitrust e le forme di protezione della privacy dei dati e di rafforzare gli incentivi di sostegno pubblico alle iniziative private nello sviluppo dell’intelligenza artificiale. L’obiettivo è coltivare “campioni nazionali”, con poca attenzione ai rischi legati alla concentrazione del potere o alle conseguenze ambientali delle scelte legate all’innovazione tecnologica. Questa azione di lobby finora ha incontrato l’opposizione dell’amministrazione Biden, il cui intervento è orientato a mantenere la concorrenza nell’industria tecnologica statunitense.

In tale quadro, l’Europa è esclusa dalla gara che vede competere USA e Cina nella corsa alla produzione dell’IA. Anche per questo, pur dichiarando come obiettivi la sovranità digitale dell’UE e la creazione di “campioni europei”, nei fatti sta assumendo un posizionamento distintivo nella protezione dei cittadini e dei lavoratori. Le politiche principali riguardano la data governance (privacy, sicurezza, trasparenza, non discriminazione), la formazione e il dialogo sociale.

Rispetto al primo gruppo di politiche, l’iniziativa oggi è prevalentemente a livello sovranazionale (AI Act promosso dal Parlamento europeo; Hiroshima AI Process concordato dal G7). Le politiche formative e quelle relative al dialogo sociale invece vengono promosse a livello nazionale. Per limitarsi a qualche esempio, l’Irlanda ha introdotto percorsi di istruzione, mentre Germania, Finlandia e Spagna percorsi di formazione continua per l’aggiornamento sull’IA; in Germania, Francia e Italia il dialogo sociale ha portato ad accordi con rappresentanti dei lavoratori per il monitoraggio dei lavoratori tramite tecnologie digitali.

L’Italia e il ruolo del PNRR

Il programma Next Generation EU, attuato da ogni Stato membro con il Piano nazionale per la ripresa e la resilienza (PNRR) per il periodo 2021-26, rappresenta uno strumento centrale per la promozione di una politica industriale orientata alla just transition, in cui alla transizione digitale si affianca quella ecologica.

Per quanto riguarda l’Italia, le analisi dimostrano che la quota di occupazione nei beni e servizi ambientali al momento è limitata. Tuttavia, anche questa tendenza potrebbe cambiare nel prossimo futuro: uno studio della Banca d’Italia prevede che gli obiettivi di riduzione delle emissioni di CO2 assumeranno un ruolo sempre più centrale nelle attività produttive.

Le implicazioni di queste due transizioni per l’occupazione sono al centro di diverse linee di intervento del PNRR, perché trasversali a diversi settori. Il governo italiano ha stimato che gli investimenti previsti dal PNRR avranno un impatto significativo sulle principali variabili macroeconomiche, tra cui un aumento dell’occupazione pari a 3,2 punti percentuali nell’ultimo triennio del Piano (2024-26) e miglioramenti marcati negli indicatori che misurano i divari regionali, l’occupazione femminile e l’occupazione giovanile. Le proiezioni presentate nel XXIV Rapporto CNEL Mercato del lavoro e contrattazione collettiva (2022) mostrano che il PNRR, nonostante la dimensione sistemica e la scala degli investimenti, potrebbe avere un impatto ridotto rispetto alle aspettative per effetto della carenza di competenze e il mismatch delle stesse rispetto ai posti di lavoro vacanti.

Un dato particolarmente significativo riguarda le professionalità attese, con oltre il 60% del fabbisogno nel quinquennio tra il 2022 e il 2026 che interesserà il possesso di competenze green e la previsione di difficoltà nel reperimento delle professioni cruciali per gli avanzamenti nei processi di innovazione tecnologica. La carenza di queste figure – in mancanza di interventi tempestivi orientati ad aumentarne l’offerta – potrebbe determinare dei rallentamenti nell’implementazione delle missioni del PNRR. Tra gli interventi più rilevanti per determinare gli scenari futuri, c’è dunque consenso nell’identificare la centralità della formazione per la riconversione delle professionalità dei lavoratori attraverso aggiornamento (upskilling) e riqualificazione (reskilling), a partire dal Piano nuove competenze del PNRR.

In questa stagione di rinnovata attenzione al ruolo dello Stato nell’economia, le iniziative relative alle infrastrutture digitali ed ecologiche non possono dunque prescindere da una riflessione attenta sulle infrastrutture sociali e sulle politiche che possono favorire un protagonismo degli attori sociali nell’indirizzare le trasformazioni dell’economia.

Leggi anche

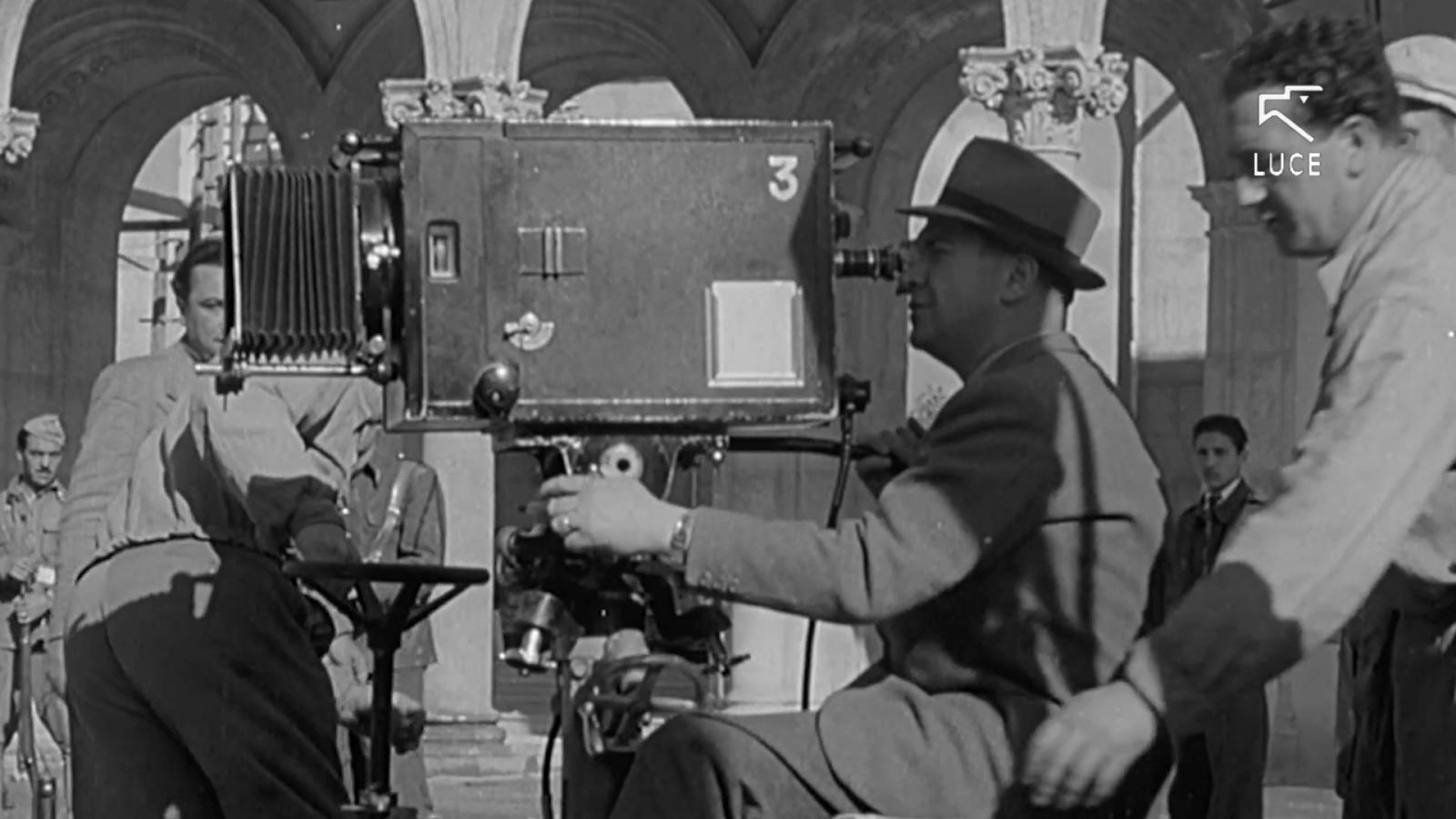

100 anni di Istituto Luce, la storia d’Italia raccontata per immagini

Podcast, proiezioni e mostre per celebrare il secolo di vita dell’archivio cinematografico e fotografico

Don Chisciotte e Calibano

Le macchine inseguono l'umanità nel tempo, suscitando timori di sostituzione.

Futuro digitale

Da almeno un ventennio, il discorso pubblico sul futuro della nostra economia oscilla tra due estremi.

Homo Digitalis. Una sfida all’invisibile e il Big Bang del Metaverso

Intervista a Simone Arcagni, professore all’Università di Palermo.