Perchè parlare dell'etica delle macchine non è più fantascienza

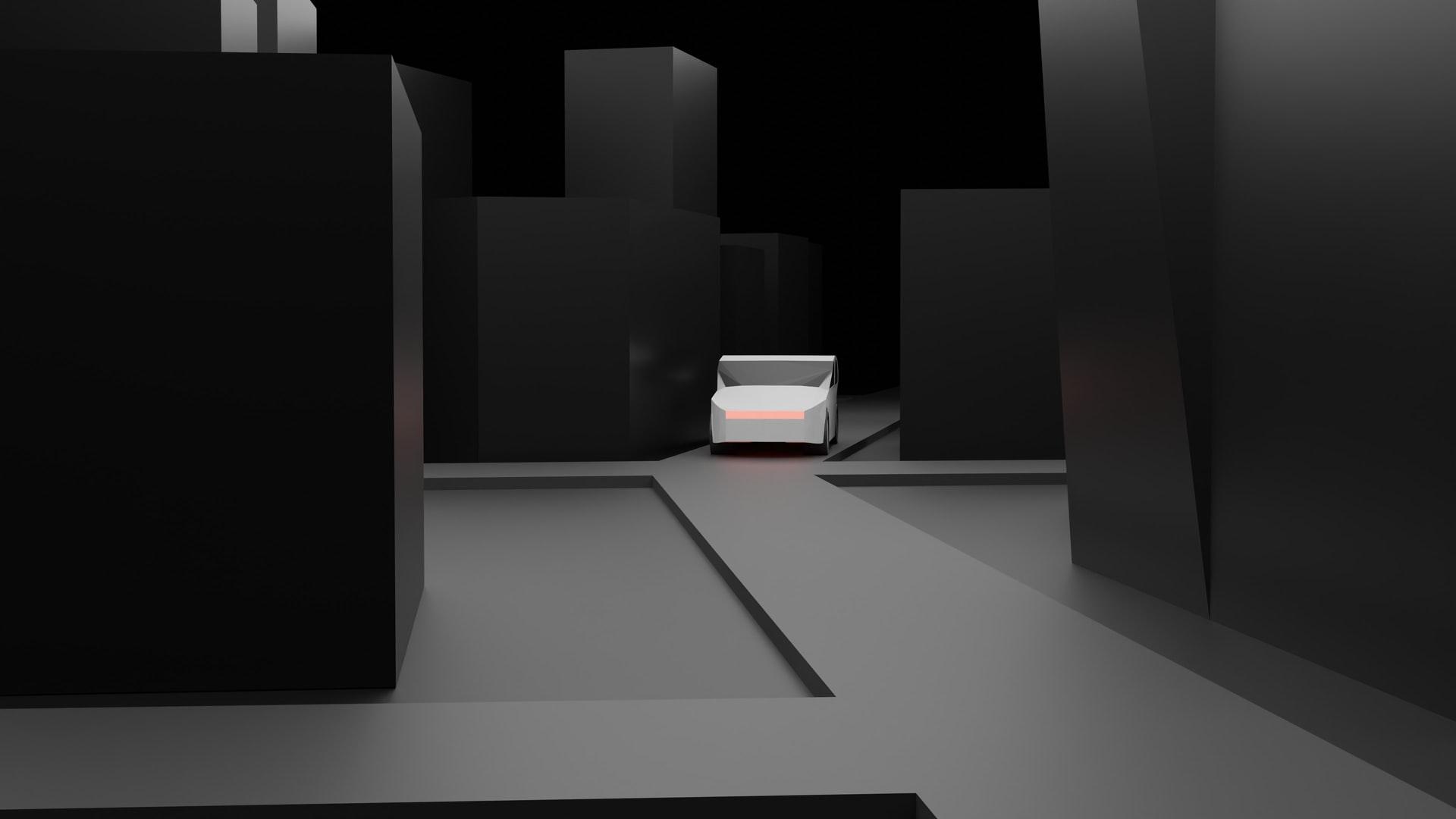

Immaginate una auto rossa che sfreccia in una strada semideserta. Si tratta di un veicolo automatico, progettato per una guida autonoma capace di limitare l’errore umano attraverso una intelligenza artificiale (AI), che segue diversi protocolli per bilanciare il benessere del passeggero e il codice stradale.

Quest’auto rossa mentre prosegue per il suo tragitto si trova di fronte ad un problema, dagli estremi della carreggiata escono frettolosamente due biciclette, una guidata da un bambino con il casco e le protezioni, l’altra da una signora anziana sprovvista di un qualsiasi accessorio per la sicurezza. La macchina rossa va troppo veloce per fermarsi ed entrambe le biciclette sono nella sua traiettoria, il veicolo autonomo quindi può soltanto scegliere o se investire uno dei due in pieno, salvando l’altro, o colpirli entrambi. Da una parte l’algoritmo opterà per una visione, chiamata etica delle conseguenze, che la spingerà a cercare di minimizzare le perdite umane, compiendo un cambio di rotta investendo uno dei due, più probabilmente il bambino, in quanto le sue protezioni nonostante la collisione dovrebbero attutire il danno, dall’altra parte una altra concezione, che chiameremo etica dei mezzi, la porterà a non voler pregiudicare la vita di una donna innocente e di un bambino, e soprattutto del proprio conducente, che sceglierà di proseguire nella traiettoria considerando per entrambi un danno più superficiale, salvando soprattutto l’integrità del veicolo. Di fronte ad un problema etico come questo voi deleghereste questa scelta all’algoritmo della vostra auto automatica? Una scelta che in questa curiosa rivisitazione del problema del carrello ferroviario, non può non far notare la complessità di un giudizio morale, che in quanto tale non è guidato dalla sola ragione, ma dalla sensibilità. Una sensibilità che rende eterno il motto pascaliano per cui il cuore ha delle ragioni che la ragione non conosce, che si esplicano attraverso un giudizio umano difficilmente rappresentabile da un algoritmo. Dai veicoli automatici, ai curricula analizzati dalle AI, dalle armi automatizzate ai giudici robot quanto la necessità di controllo ed ordine sta portando una spersonalizzazione e deresponsabilizzazione dell’uomo?

Credits: Shubham Dhage su Unsplash

Nel parlare di questi temi occorre rileggere il testo di Guglielmo Tamburrini: “Etica delle macchine. Dilemmi morali per robotica ed intelligenza artificiale” (CAROCCI EDITORE). Nel suo libro Tamburrini analizza le implicazioni etiche dello sviluppo delle tecnologie automatizzate, mostrando quanto sia importante non lasciare esclusivo spazio all’efficienza di un provvedimento, ma soprattutto dare attenzione all’implicazione morale ed etica. Il mondo descritto nel saggio non è un futuro distopico raccontato da Isac Asimov, ma è una parte dello sviluppo tecnico che sta plasmando il presente.

Le leggi della robotica non riguardano più la robotica, ma la giurisprudenza adesso.

Dai primi mesi del 2022 la Germania ha, infatti, introdotto i veicoli automatici nella viabilità urbana, le maggiori aziende iniziano ad associare ai loro delegati delle risorse umane, algoritmi per la selezione del personale, in Cina la prefettura di Shangai ha adottato, dopo la Lettonia, il primo “giudice robot”. Una serie di scelte che in nome dell’efficienza e dello sviluppo continuano a delegare le responsabilità degli individui e delle istituzioni nelle mani di AI, nonostante la ancora troppa vasta possibilità di errore, che sarebbe intollerabile per una controparte umana. Non sarebbe allora lecito domandarsi se in un futuro prossimo non sia legittimo impedire agli esseri umani di guidare perché pericolosi per l’ordine pubblico, oppure se non si valuti, compatibilmente ad un maggiore sviluppo dell’AI, che i giudici vengano sostituiti dai robot, in nome di una maggiore imparzialità o per evitare discriminazioni. Tutti scenari che si affacciano al presente e che pongono il focus su chi ricada le responsabilità delle macchine. Se la macchina dell’esempio avesse ucciso uno dei due ciclisti chi avrebbe pagato, l’azienda? Il programmatore? L’ingegnere a capo del progetto? Delle responsabilità etiche troppo importanti che graverebbero su una figura con delle competenze relative all’aspetto esclusivamente tecnico di tali AI. In questo scenario il testo di Tamburrini propone un approccio multidisciplinare capace di combinare ingegneri e filosofi, efficienza e morale per la realizzazione di una etica per la civiltà delle macchine. Una sinergia necessaria per non confondere l’imparzialità con l’insensibilità.

Leggi anche

100 anni di Istituto Luce, la storia d’Italia raccontata per immagini

Podcast, proiezioni e mostre per celebrare il secolo di vita dell’archivio cinematografico e fotografico

Don Chisciotte e Calibano

Le macchine inseguono l'umanità nel tempo, suscitando timori di sostituzione.

Futuro digitale

Da almeno un ventennio, il discorso pubblico sul futuro della nostra economia oscilla tra due estremi.

Homo Digitalis. Una sfida all’invisibile e il Big Bang del Metaverso

Intervista a Simone Arcagni, professore all’Università di Palermo.